呂修齊/Northeastern University, Network Science Institute

本文改寫自作者之期刊論文Lu, H. C., & Lee, H. W. (2024). “Agents of Discord: Modeling the Impact of Political Bots on Opinion Polarization in Social Networks.” Social Science Computer Review, 08944393241270382.;與碩士論文《紛亂的行動者:模擬社群媒體機器人在複雜網絡中對意見極化的影響》,該文獲得2024年臺灣社會學會碩士論文獎。

「網路極化」無疑是這幾年最讓人有感的社會現象之一。你可能跟我一樣,滑開 Threads、Facebook或是X等社群媒體時,會發現許多議題──無論是嚴肅的政治與社會公共討論,還是生活中的大小事──討論都彷彿被推向兩端。其中,理性對話的空間越來越窄,取而代之的是劍拔弩張、互不相讓的言論。這種「意見極化」的日常,讓人不禁納悶:究竟是誰在幕後操縱,讓我們的網路世界變得如此壁壘分明?

身處台灣,我們對於網路上「那隻看不見的手」感受可能特別深刻。每逢選舉就沸沸揚揚的「帶風向」爭議、各種社會事件引發的兩極化論戰,以及疫情期間或民生議題上,那些真假難辨、似是而非的資訊,背後常常浮現境外勢力──特別是中國資訊戰操作的影子。這些旨在影響台灣民意的行動,往往大量運用自動化社群媒體機器人,也就是大家耳熟能詳的「網軍」或「假帳號」。

究竟,這些披著人類外衣的政治機器人,是如何一步步加劇社會撕裂?而面對這樣的困境,我們又能做些什麼?我們的研究透過代理人為本模型(Agent-Based Model)進行電腦模擬,試圖解答這個關鍵問題。

混亂的行動者:社群媒體機器人

簡單來說,「社群媒體機器人」是一群由程式設計出來的自動化帳號,其目的並非理性說服、讓更多人相信自己的立場,而是在網路上「搞事」,甚至「製造混亂」。這些機器人能以驚人的速度持續發布、轉發、留言,甚至學習並模仿人類的行為模式。相關研究已揭露,社群媒體上約有9%到15%的活躍帳號,實際上是由這些自動化機器人所操控。它們就像數位世界中潛伏的「混亂行動者」,透過大量、重複或極端的資訊轟炸,試圖扭曲事實、激化不同陣營的情緒,進而破壞正常的公共對話空間。尤其隨著人工智慧(AI)的快速發展,這些機器人的行為越來越擬人、也越來越難以被察覺,使網路資訊環境變得更加複雜,也更難以辨識資訊真偽。

在電腦裡建立一座複雜社群網路系統:我們的研究怎麼做?

為了深入探討社群媒體機器人如何影響意見極化,我們利用一種叫做「代理人基模型」(Agent-based model)的電腦模擬方法。這種方法普遍應用於研究複雜系統(Complex System),近幾年也越來越常被使用於計算社會科學(Computational Social Science)。大家可以把它想像成一個大型的「社會實驗室」,我們在電腦裡建立了模擬的社群網路,裡面有成千上萬個「代理人」──有些是人類,有些就是我們想研究的「社群媒體機器人」,讓他們在網絡中依照設定的規則進行模擬互動,由下而上的模擬社會現象形成的動態過程。這種方法特別適合研究由許多相互作用的個體組成的複雜系統。

我們以「有界信心模型」(Bounded Confidence Model)為基礎。這個模型的核心假設是:人只會聽取和自己意見「差異不大」的人的觀點。這就像在同溫層裡,你比較容易接受跟你觀念接近的朋友的說法。我們在模型中加入了兩個非常重要的變數:「包容度」(Tolerance)和「同質性」(Homophily)(圖1)。其中,「包容度」衡量一個人願意接受與自己意見不同的程度,即其「彈性空間」;「同質性」則是指人們只與意見和自己相近者互動的傾向。

我們的模擬從一個「社會意見中立」的假設開始:當一個新議題剛出現,大家還沒有太多既定立場。人類的意見一開始集中在中間,呈現常態分佈。而機器人的意見則被設定為傾向兩端極值(用Beta分佈表示),且它們的意見不會隨著互動改變,只會持續散佈它們的極端觀點。然後,我們把這些政治機器人放進不同類型的社群網路(如隨機網路、小世界網路、無尺度網路等,以模仿真實社群媒體的結構),觀察它們如何與人類代理人互動,以及這些互動如何推動整體社會意見的變化,尤其是否會導向極化。

機器人「攪局」的幾個關鍵

(一)基礎模型:「量」的影響

通常,代理人基模型的研究會從最基本的「基礎模型」出發,這就像建立一個簡化的世界,用來驗證最核心的假設。代理人基模型的特別之處,就在於它能從個體(人類與機器人)的簡單互動規則出發,模擬出整體社會層面可能發生的複雜現象。這種方法的核心概念是:鎖定一個特定的社會現象,然後透過模型複製出其運作模式。一旦我們成功重現了這個模式,就能回頭推導出造成該現象的潛在機制,理解其背後的運作原理。

在本研究中,我們鎖定的現象是網路上的「意見極化」,以及社群媒體機器人對其的影響。透過模擬,我們成功複製了意見極化的模式,這讓我們得以更深入地探討其發生的機制,並套上不同的社會情境,觀察結果會如何改變。

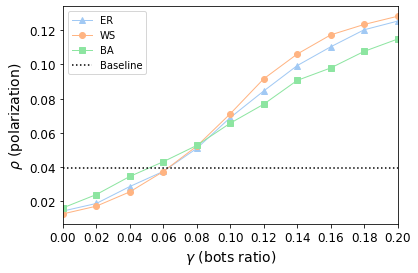

在這個基礎模型中,我們首先探討了社群媒體機器人「數量」對意見極化的影響(圖2)。結果顯示,這可能也是最直觀的發現:無論在哪種網絡,當網路中機器人的比例越高,人類意見的極化程度就越顯著。想像一下,一個本來意見溫和的網路社群,隨著機器人越來越多,人類的觀點就逐漸被推向兩端,社會意見的裂痕不斷擴大,最終分裂成壁壘分明的陣營,形成明顯的兩極對立局面。

(二)「彈性空間」的奧秘:不是越包容,社會就越和諧!

在基礎模型下,我們進一步模擬:當人們擁有不同「包容度」與「同質性」時,意見極化程度會如何變化。你可能會直觀地認為,如果大家對不同意見都能展現出更高的「包容度」,社會自然就會走向和諧,意見對立也會減少。然而,我們的研究卻發現了一個出乎意料,甚至有些反直覺的「臨界點」。

透過模擬,我們觀察到:當人類代理人對不同意見的「包容度」(也就是願意接受異見的彈性空間)非常低時,意見極化反而不太容易發生。因為當人們什麼都聽不進去、只活在自己的小圈子裡時,意見根本難以跨越界線傳播,不同群體之間就像平行線一樣,各自表述,雖然缺乏交流,但也難以形成激烈的大規模對立。

同樣令人驚訝的是,當包容度非常高,高到人們對任何觀點都「照單全收」、無所謂時,意見也會傾向於收斂,不容易走向極端。這時候,所有的資訊都容易被接受,最終可能趨向於某種模糊的中立。

那麼,什麼情況下最容易引發極化呢?我們的研究指出,真正容易被社群媒體機器人影響而導致極化的,反而是那些對不同意見「既不會完全排斥,也不會照單全收」的中間地帶人群。這說明當社會在意見交流上處於一種「中庸」狀態時,反而最容易受到這些「混亂行動者」的操縱,被推向極端。而這,很可能正是我們社會上大多數人的真實寫照——我們既沒有厲害到能對所有意見一視同仁,也沒有狹隘到完全不接受任何異見。

在這個過程中,「同溫層」效應也扮演了關鍵角色。我們的模擬同時考慮到:當人們越傾向只與意見相似的人互動(也就是「同質性」高)時,社群媒體機器人的影響力也會被放大。這兩者相互作用,使得在「包容度」恰好處於易感區、且「同溫層」足夠厚實的環境下,意見極化會更加嚴重,社會分裂的趨勢也更明顯。這揭示了一個複雜的現實:社群媒體上的「彈性空間」並非越大越好,其微妙的平衡點,正是機器人趁虛而入的機會。

(三)機器人的影響力不在多,在於「中心」程度

接下來,人們可能會直覺地認為,要影響整體輿論,機器人帳號的數量必須非常龐大。但透過電腦模擬,我們揭示了一個關鍵發現:即使社群媒體上的機器人數量不多,只要它們佔據社群網絡中的「核心位置」,或扮演「意見領袖」的角色,其對意見極化的影響就可能極為深遠(見圖4)。

想像一個擁有數十萬甚至上百萬粉絲的高中心性機器人帳號,它可以輕易將訊息擴散至大量受眾。即使這樣的帳號數量極少,其所傳播的極端言論,觸及範圍與影響力仍遠遠超過一群位於網絡邊緣、無名無勢的機器人。這提醒我們,在防範網路操控時,不能只關注數量,更要重視這些「混亂行動者」在網絡中的「位置」與「影響力品質」。

此外,除了上述核心實驗情境,我們也進一步探討了其他不同條件下(例如調整網絡結構特性,或模擬人們對機器人的警覺程度提升)對意見極化的影響,並進行了多項模擬實驗,試圖理解社群媒體中極化現象的複雜動態。

面對機器人「搗亂」,我們能怎麼辦?

我們的研究清楚地描繪了社群媒體機器人如何在社群媒體中扮演「意見極化推手」的角色。面對這種數位時代的新挑戰,完全杜絕機器人影響可能不太現實,因為這就如同期望所有人都能保持絕對的包容、不包容或中立一樣不切實際。但即便如此,我們仍能採取一些措施,來減輕它們的影響,並提高惡意資訊傳遞的成本。

1.限制機器人的「關鍵位置」:既然少量但位居核心的機器人能產生巨大影響,社群平台和監管單位就應致力於防止機器人佔據網路中的高「中心性」位置。我們的模型顯示,當機器人被邊緣化時,它們散佈極端意見的效率將大幅降低。

2.及早處理「小火苗」,而非只關注「大火災」:研究中,我們的模型強調了網路資訊傳播效率與機器人影響力的關聯性。這暗示著當今社會資訊生產與消費的速度,正助長著機器人的影響力。因此,我們應優先處理那些剛出現、還未大規模擴散的小議題和爭議,而不是等到它們已經成為「熱門話題」才介入。及早預防和預測,對於限制資訊的快速傳播至關重要。

3.提升公眾對數位時代的警覺:最後但同樣重要的是,全面提升公眾對數位時代挑戰的認識。透過揭示機器人的存在,並闡明數位空間中的混亂運作機制,我們或許無法完全根除這些混亂,但絕對可以大幅提高惡意散播資訊的成本。當人類對機器人的信任程度降低時,意見極化的趨勢也會被削減,雖然無法完全消除,但能有效減輕其影響。

結論

這項研究從微觀視角揭示了社群媒體機器人導致公共意見極化的機制。我們透過理論模擬,證實當機器人刻意採取意見光譜兩端的極端立場時,其存在會加劇社會意見的扭曲與極化。同時,我們指出了影響此現象的幾個關鍵決定因素;並探討在什麼樣的狀況下,機器人的影響力會擴大或降低。此外,我們亦成功模擬出真實世界中常見的「不對稱極化」現象(例如當不同立場的人們對同溫層的依賴程度不同時,極化效果也會出現差異),進一步證明了本模型在解釋複雜社會現象上的普適性與解釋力。

複雜系統研究方法與計算社會科學,在理解當代社會問題上展現出強大潛力。傳統社會學研究在分析大規模、動態且多重因子交織的社會現象時,常面臨資料取得不易或難以控制變項的挑戰。而透過代理人基模型,我們得以在電腦中建立一個「人工社會」,從個體的行為規則出發,模擬並觀察社群互動如何導致宏觀的社會模式。這種由下而上的模擬方式,使得我們能像在沙盤推演般,清晰地釐清不同因子如何相互作用,進而解釋意見極化等複雜現象的發生機制。這為社會學研究提供了一種嶄新的工具,能夠更精準、動態地剖析複雜的社會困境。

當然,這類跨學科研究也面臨著獨特的挑戰與限制。除了涉及多學科的知識與複雜計算,在高度複雜的社會系統中,我們不可能窮盡所有因素。例如,本研究所採用的網路為靜態網路,但真實的社會網路是動態變化的,人們的連結方式會隨著時間和互動而改變,甚至極化本身也可能導致網路結構的「分裂」現象。此外,這類型動態、高維度與非線性的模擬,也增強了模型的不確定性,以及分析與預測上的困難。

最後,隨著大數據研究興起以及運算力的提升,複雜科學已逐漸成為顯學。然而,在台灣,這似乎仍是個陌生的領域。在當前網路資訊盛行的背景下,結合計算科學方法來分析社會現象,將是我們理解並應對數位時代挑戰的關鍵。這不僅僅是學術上的探索,更是面對錯綜複雜的社會問題時,不可或缺的分析視角與應對策略。這項研究期許能為台灣學界在計算社會科學與複雜系統領域的發展,拋磚引玉,激發更多元深入的探討。